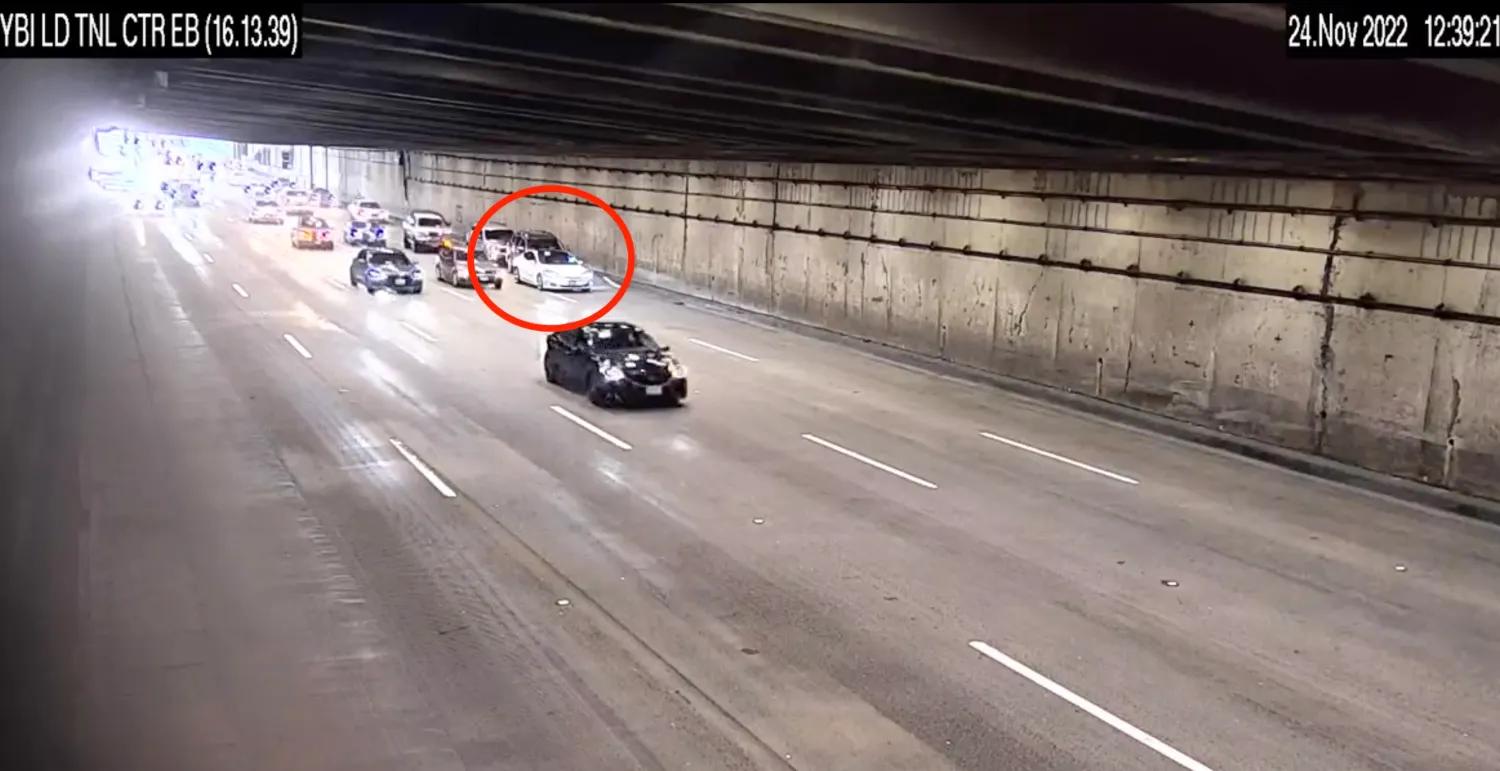

Vidéo : le « freinage fantôme » d’une Tesla provoque un accident avec 8 voitures dans un tunnel

Une vidéo d’un accident provoqué par une Tesla en mode Autopilot à San Francisco vient d’être publiée.

Le système Autopilot (pilotage automatique ou conduite autonome) des Tesla a déjà fait couler beaucoup d’encre et continue à susciter débats et polémiques.

Il faut dire qu’entre les avancées technologiques des constructeurs et les contraintes imposées par le législateur, il devient difficile de s’y retrouver entre ce qui est autorisé et ce qui ne l’est pas. Et si en plus les voitures confondent certains éléments de la chaussée avec des obstacles devant lesquels il est urgent de piler, cela donne ce genre de situation.

Des images du fameux accident de huit voitures causé par une Tesla en mode « Pilotage automatique complet » à San Francisco en novembre ont été diffusées.

I obtained surveillance footage of the self-driving Tesla that abruptly stopped on the Bay Bridge, resulting in an eight-vehicle crash that injured 9 people including a 2 yr old child just hours after Musk announced the self-driving feature.

Full story: https://t.co/LaEvX9TzxW pic.twitter.com/i75jSh2UpN

— Ken Klippenstein (@kenklippenstein) January 10, 2023

Il semble s’agir d’un cas classique de freinage fantôme, mais il est également important de noter que, pendant la conduite assistée de niveau 2, le conducteur aurait dû réagir. Tesla ne possède pas de mode « autonome ». La marque a plutôt un forfait intitulé « Pilotage automatique complet » (ou FSD pour Full Self Driving, l’option la plus élevée), qui inclut désormais la version bêta de ce système.

Ce dernier permet aux véhicules Tesla de rouler de manière autonome jusqu’à une destination entrée dans le système de navigation de la voiture, mais le conducteur doit rester vigilant et prêt à reprendre le contrôle en tout temps. Comme la responsabilité repose sur le conducteur et non sur le système de Tesla, il est encore considéré comme un système d’aide à la conduite de niveau 2, malgré son nom.

Freinage fantôme ou arrêt délibéré et inconscient du conducteur ?

Suite à l’accident, le conducteur de la Tesla a déclaré à la police que la voiture était en mode « Pilotage automatique complet », mais la police semble avoir compris les nuances de l’accident. La dernière version bêta de Tesla de conduite autonome complète était la 11, et est classifiée comme niveau 2 selon SAE International. Or le niveau 2 n’est pas considéré comme un véhicule autonome. Selon la classification de niveau 2, l’être humain dans le siège conducteur doit constamment surveiller les fonctions d’assistance, y compris la direction, le freinage ou l’accélération selon les besoins pour maintenir la sécurité.

Si le logiciel de capacité de conduite autonome complet a dysfonctionné, le conducteur aurait dû reprendre le contrôle manuel de la voiture en désactivant la fonctionnalité de conduite autonome complète. Pour cela il suffit d’intervenir sur le frein ou l’accélérateur.

En l’occurrence, à la vue des images de la vidéo, on ne comprend pas très bien pourquoi la voiture s’arrête complètement et ne repart pas, provoquant cet accident en chaine, alors qu’il aurait suffi au conducteur d’effleurer la pédale d’accélérateur pour annuler ce freinage fantôme. De plus, le clignotant gauche est activé et la voiture semble dévier sur le bas côté comme si elle cherchait à se garer. Un comportement très étrange qui ne ressemble pas à un freinage fantôme mais plutôt à un arrêt délibéré du conducteur. Peut-être un malaise ?

L’enquête en cours devrait permettre d’en savoir plus.